En kronikk av Tor W Andreassen, professor ved Norges Handelshøyskole og leder av Open Innovation Lab of Norways faglige råd

Vi trenger en oppdatert nasjonal AI strategi for utvikling og distribusjon av generativ AI som gagner samfunnet som helhet.

Du har helt sikkert fått med deg den gryende to-sidige «endre verden-debatten» om generativ AI. Den vil enten ødelegge oss – eller forvandle oss til en lykkeligere, mer hyperkreativ og produktiv art.

Veien fremover er preget av to sannheter som viser at vi har liten tid. For det første er det en enkel lov om virksomhet og teknologi som sier at dersom det kan bygges, vil det bli bygget. Derfor er ideen om at land, selskaper eller enkeltpersoner vil sette arbeidet sitt på pause, noe naivt. De vil ikke det.

For det andre er det en enkel regel for moderne styring som sier at teknologi alltid utvikler seg raskere enn reguleringen av den. Derfor er ideen om at en regjering eller regjeringer kommer sammen for å regulere AI, noe naivt. De har ingen sjanse og det er bekymringsfullt.

De siste måneders adopsjonsrate av ChatGPT viser at at AI-teknologien kommer med en hastighet nesten ingen utenfor AI-selskapene er klar over. Vi snakker måneder – ikke år – før virkningen treffer oss som ledere, ansatte, kunder, og innbyggere.

Fordi tiden er knapp og utviklingen rask, ref utviklingen av GPT4, er det problemstillinger av demokratisk og etisk betydning som vi må bevisstgjøre oss på. Vi trenger sårt kjøreregler i form av en nasjonal AI policy for å sikre demokratiet og hjelpe oss i etiske dilemmaer.

For det første kan generativ AI-teknologi utfordre demokratiet ved at den kan true vår tillit til juridiske, politiske, og økonomiske institusjoner av tre grunnleggende årsaker.

1. Generativ AI kan brukes til å lage ekstremt realistiske deepfake-videoer, lydopptak og bilder som kan brukes til å spre feilinformasjon eller propaganda. Dette kan være spesielt skadelig under valgkamper, der falsk eller villedende informasjon kan påvirke opinionen og undergrave den demokratiske prosessen.

2. Generativ AI kan brukes til å lage målrettet innhold, for eksempel falske nyhetsartikler eller innlegg på sosiale medier, som er utformet for å manipulere opinionen eller skape uenighet. Dette kan brukes til å undergrave tilliten til demokratiske institusjoner, politiske partier eller kandidater.

3. Generativ AI kan opprettholde eksisterende skjevheter og diskriminering mot for eksempel kjønn, religion, og hudfarge. Dette kan ha betydelige konsekvenser for demokratiske prosesser, som for eksempel velgerundertrykkelse eller ulik representasjon.

For det andre medfører AI teknologi at vi står overfor store og viktige problemstillinger og avveininger av etisk betydning. Et forhold er at teknologien kan generere ekstremt realistiske og virkelighetsnære bilder samt lyd og tekst, som kan brukes til å lage deep fake videoer eller etterligne individer. Dette kan reise alvorlige personvern-problemer. I sum kan dette skape muligheter for ondsinnede aktører til å spre feilinformasjon som kan polarisere samfunnet 10 ganger sterkere enn Youtube, TikTok, eller Facebook eller utføre målrettet svindel mot sårbare grupper på en måte som truer rettssystemet og troen på det.

Et annet forhold er at generative AI-systemer kan brukes til å lage nytt innhold, for eksempel tekst, kunstverk eller musikk. En utfordring er at det kan være vanskelig å avgjøre hvem som eier opphavsretten eller immaterielle rettigheter for generert innhold. Dette kan føre til juridiske tvister om eierskap og kompensasjon for generert innhold.

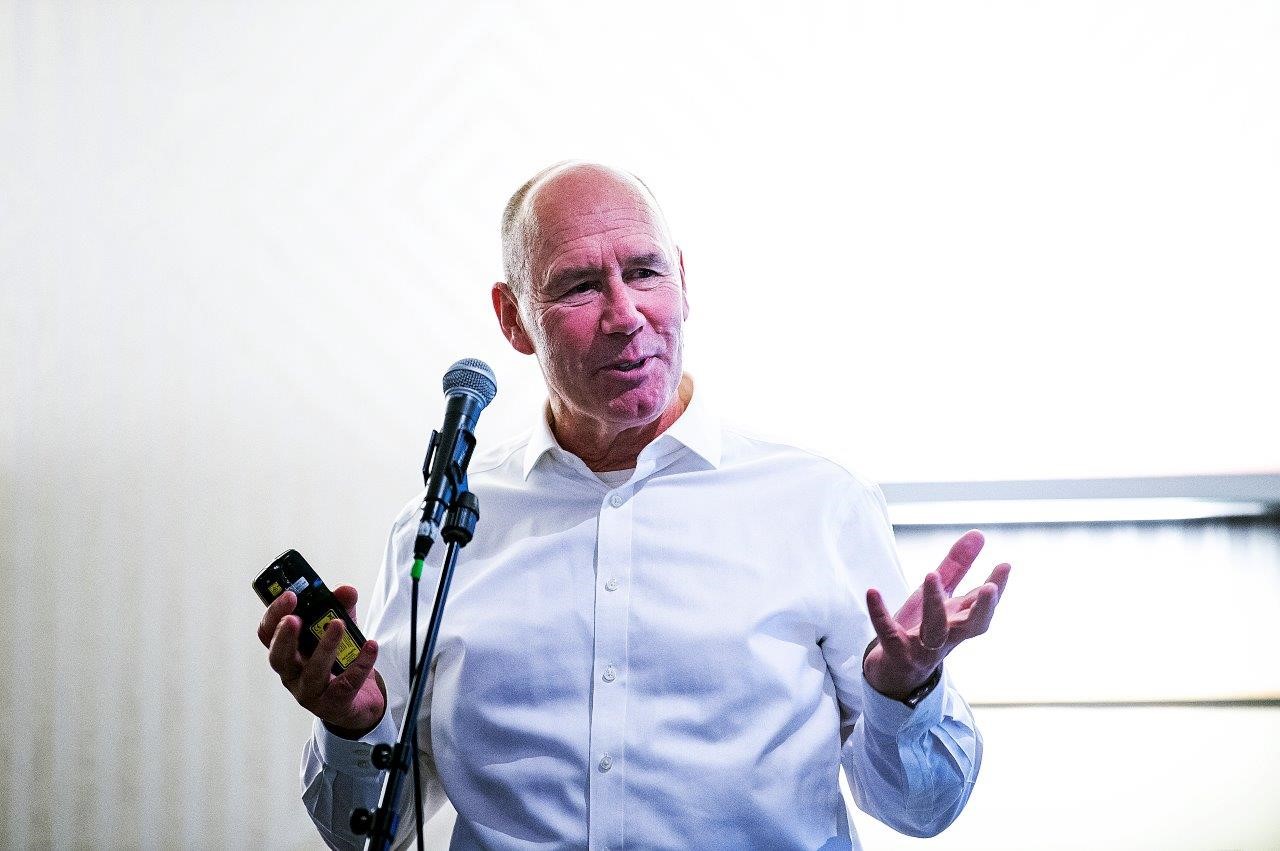

Da Nikolai Astrup (H) var Digitaliseringsminister fikk vi raskt på plass en nasjonal digitaliseringsstrategi for å hjelpe virksomhetene. Nå trenger vi sårt etiske retningslinjer for utvikling og distribusjon av AI, sikring av åpenhet og ansvarlighet i AI-beslutninger, og investering i AI-forskning og -utvikling som gagner samfunnet som helhet. AI strategien fra 2020 må oppdateres. Vi må aldri glemme at det er vi som styrer teknologien og ikke omvendt. Men vi må følge med i timen. Å sette utviklingen på vent, er ikke en opsjon.